Informe de progreso de la IA de Biden: seis meses después

Tabla de contenido:

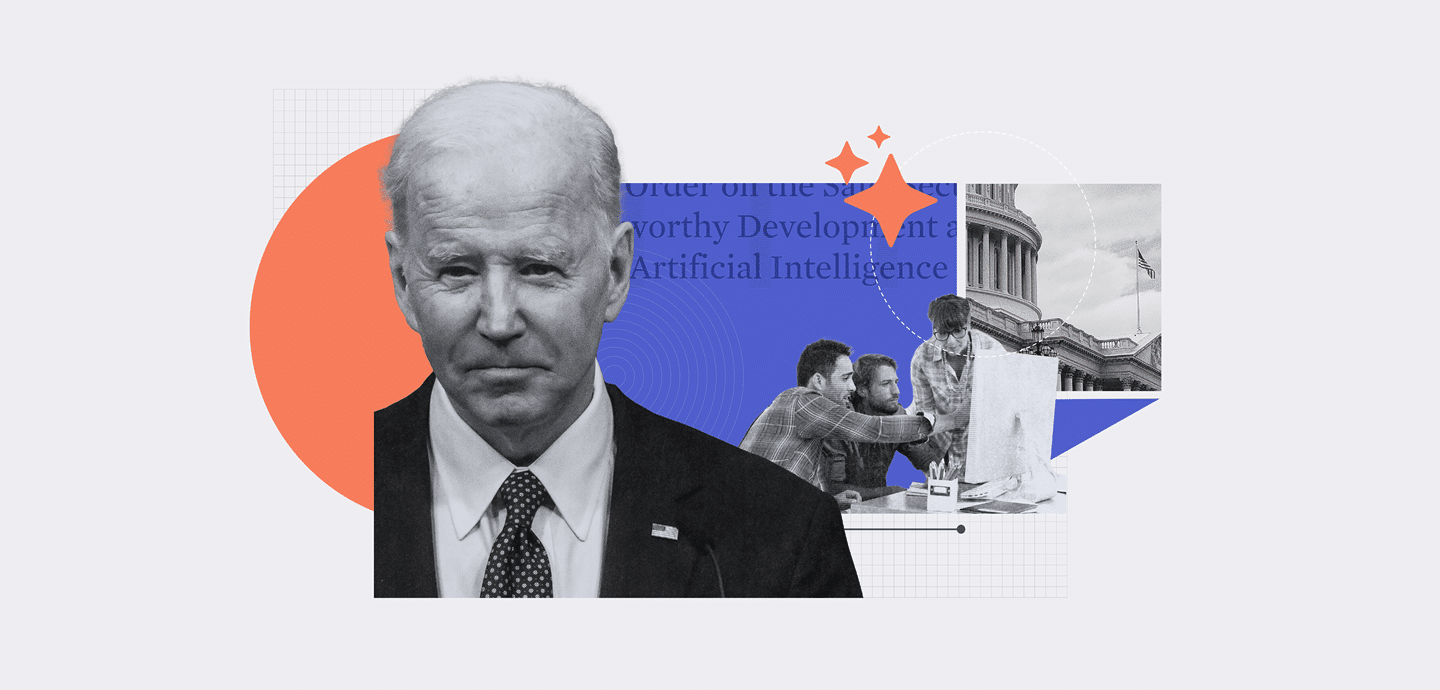

Han pasado seis meses desde que el gobierno de EE. UU. aprobó una amplia orden ejecutiva (EO) que aborda la necesidad de una IA responsable. El Orden Ejecutiva sobre Inteligencia Artificial Segura, Protegida y Confiable abordó las preocupaciones sobre la seguridad de la IA, junto con su efecto sobre las libertades civiles y los derechos de los trabajadores. También reconoció la necesidad de aumentar drásticamente el conjunto de habilidades de inteligencia artificial de la fuerza laboral federal. Estas preocupaciones se tradujeron en una amplia gama de acciones en todas las agencias federales. Medio año después, ¿cómo va su implementación?

Acción coordinada

La EO se coordinó con actividades de todo el poder ejecutivo. Las semanas posteriores a su anuncio El 30 de octubre de 2023 se produjo una oleada de actividad en varias agencias, como el anuncio del Departamento de Estado de su estrategia de IA empresarial el 9 de noviembre.

El Departamento de Defensa también tenía claramente preparada su respuesta. Casi inmediatamente después de la publicación de la EO, el Departamento de Defensa liberado su Estrategia de Adopción de Datos, Análisis e Inteligencia Artificial 2023, que reemplazó su estrategia de IA de 2018. Esta política es especialmente importante para el Pentágono, que según una Brookings Institution reporte constituye la mayor parte de los contratos federales de IA en el gobierno de EE. UU. El gasto en contratos militares de IA representó 557 millones de dólares de los 675 millones de dólares en fondos comprometidos para contratos de IA en todas las agencias en el año hasta agosto de 2023, según el informe.

Una boleta de calificaciones sólida

El 28 de marzo, la Casa Blanca reportaron que las agencias habían cumplido con todos los plazos de 90 y 150 días establecidos en la EO. Las medidas que se detallan en este análisis de línea de tiempo incluyó la producción de un informe del Departamento del Tesoro sobre la gestión de riesgos de la IA en los servicios financieros y una autoevaluación por parte de cada agencia de los riesgos que la IA representa para la infraestructura nacional crítica.

Varias agencias han contribuido al esfuerzo de seguridad de la IA. El Departamento de Comercio creó el Instituto de Seguridad de IA de EE. UU. dentro del Instituto Nacional de Estándares y Tecnología (NIST) el 1 de noviembre y desde entonces ha asignado personal y creó un consorcio para apoyar a la organización. A mediados de abril, la NSA publicó su guía sobre la implementación segura de sistemas de IA.

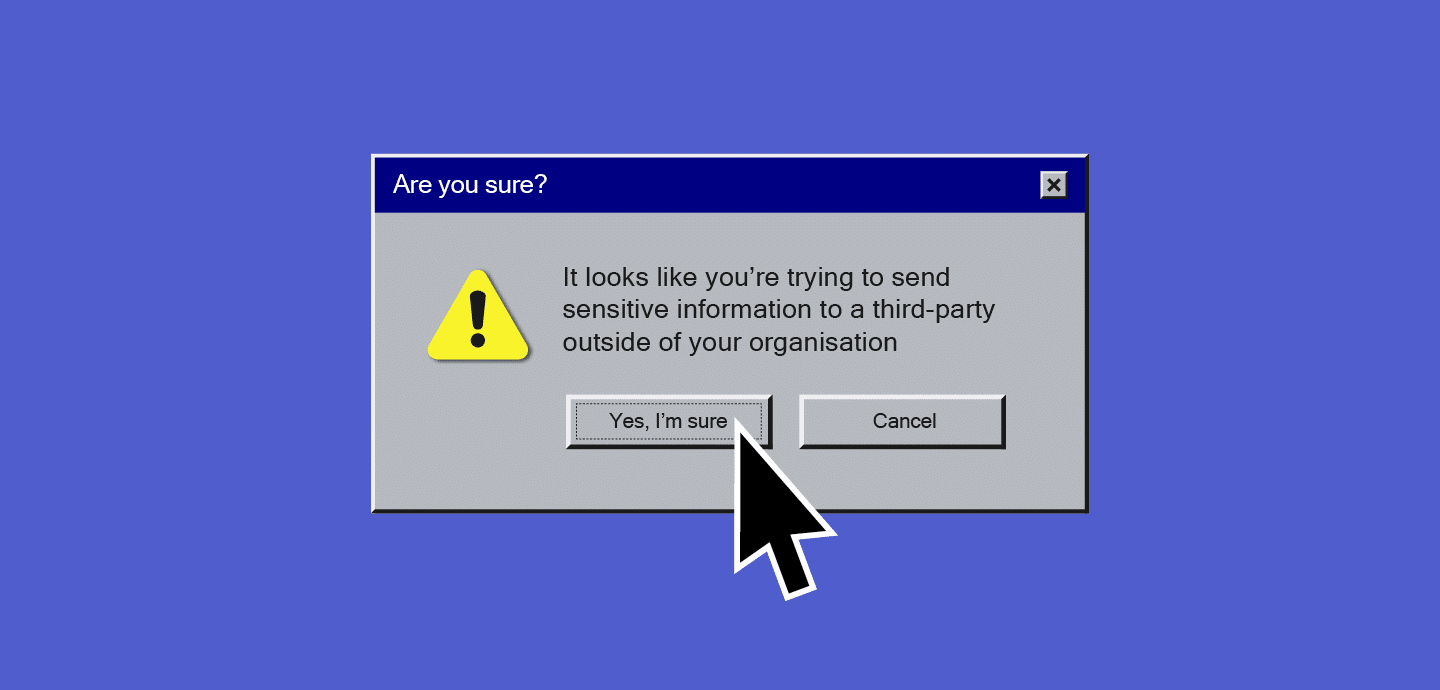

El Comité Asesor Nacional de IA (NAIC) contribuyó a cuestiones de seguridad de la IA, recomendando la introducción de un sistema para informar eventos adversos de los sistemas de IA. La recomendación de la NAIC utilizaría potencialmente como marco las definiciones de la Oficina de Gestión y Presupuesto (OMB) de IA que afectan la seguridad y los derechos. Estos fueron establecidos en el informe de la OMB del 28 de marzo. memorando sobre el avance de la gobernanza, la innovación y la gestión de riesgos para el uso de la inteligencia artificial por parte de las agencias, que consolidó muchos de los mandatos establecidos para las agencias gubernamentales ejecutivas en la EO.

Las prácticas de seguridad en el memorando de la OMB incluían un conjunto de prácticas mínimas para la IA que afecta los derechos, junto con una exigencia de que las agencias comiencen a seguirlas antes del 1 de diciembre de 2024. Si no pueden seguir estas pautas, entonces deben dejar de usar la IA en cuestión. .

Otras áreas de progreso basadas en las demandas de la EO incluyen el diseño e implementación de planes para reclutar más talentos de IA en el gobierno de EE. UU. La NAIC hizo varias recomendaciones en el cuarto trimestre de 4. Pidió mejorar la alfabetización en IA entre los estadounidenses, y también recomendó una campaña para éxito profesional de IA para toda la vida. La Casa Blanca siguió con una convocatoria de talentos de IA en una campaña de contratación en enero.

El progreso se ha extendido al arte de gobernar internacional. El Departamento de Estado anunció en noviembre que 47 estados habían respaldado la Declaración Política sobre el Uso Militar Responsable de la Inteligencia Artificial y la Autonomía, una iniciativa que lanzó en La Haya en febrero de 2023.

La Ley de Producción de Defensa: un tema tenso

Las EO generalmente afectan al sector privado ya sea a través de su impacto en los contratistas federales o a través de instrucciones dadas a agencias que hacen cumplir reglas específicas. A veces, sin embargo, la Casa Blanca invocará poderes especiales. En este caso, utilizó la Ley de Producción de Defensa para regular los modelos de IA de doble propósito.

Según esta legislación de 1950, el presidente puede obligar a las empresas del sector privado a seguir determinadas normas de producción. En este caso, los productores de IA deben informar sobre sus pruebas de seguridad de IA junto con el uso de potencia informática por encima de un umbral determinado. Los proveedores de capacidad informática también deben informar el uso de su capacidad por parte de potencias extranjeras específicas para el entrenamiento de IA.

NetChoice, una asociación comercial de empresas tecnológicas que cuenta entre sus miembros con Google, Meta y Amazon, cree que el gobierno se está excediendo en su amplia regulación. Carl Szabo, asesor general de la organización, afirma que las regulaciones, incluido el uso de la DPA como se describe en la EO, tendrán un efecto paralizador sobre la inversión del sector privado.

“Cuando comienzas a agregar limitaciones regulatorias y controles regulatorios que deben realizarse antes de poder implementar un sistema de inteligencia artificial, eso limitará mi capacidad como inversionista para llevar un producto al mercado y obtener el retorno de la inversión necesario. " él dijo.

También cree que la EO tiene un alcance tan amplio que podría impugnarse en los tribunales.

"No puedo decir cuándo va a suceder, pero puedo decir que definitivamente hay discusiones entre muchas personas de las que he oído hablar sobre la posibilidad de presentar un desafío", añadió.

Mientras tanto, el gobierno continúa cumpliendo su promesa de abordar los riesgos de la IA y su uso responsable, tras un crecimiento de casi el 260 % en sus compromisos financieros para contratos de IA durante el año hasta agosto de 2023.

Las empresas que esperan utilizar IA, especialmente aquellas que podrían verse afectadas por contratos del gobierno de EE. UU., harían bien en seguir los estándares emergentes para un uso responsable. NIST ha publicado el Marco de gestión de riesgos de IA, mientras que el recientemente publicado ISO / IEC 42001 El estándar para implementar y mantener sistemas de IA es otro marco útil a seguir. Con el paso del Ley de IA de la UE En marzo, la necesidad de demostrar las mejores prácticas a la hora de implementar la IA es más acuciante que nunca.